Ілон Маск і група дослідників закликали зупинити експерименти зі штучним інтелектом: може загрожувати людству

Будьте першими у курсі головного — підпишіться на Новини на OBOZ.UA у Google

Гендиректор SpaceX, Tesla та Twitter Ілон Маск та група спеціалістів і топменеджерів IT-галузі закликали зупинити експерименти зі штучним інтелектом. Вони бояться, що ШІ може загрожувати людству.

Ілон Маск та ще понад 1100 професорів, інженерів та дослідників підписали відкритого листа до ШІ-лабораторій з вимогою негайно зупинити принаймні на пів року навчання систем штучного інтелекту, більш потужних, ніж GPT-4. Лист опубліковано на сайті некомерційної організації Future of Life Institute.

Серед тих, хто підписав листа, співзасновник Apple Стів Возняк; Ендрю Янг, підприємець та кандидат на президентських виборах у США у 2020 році, Рейчел Бронсон, президент Бюлетеня вчених-атомників, який встановлює годинник Судного дня, співзасновник Pinterest Еван Шарп, співзасновник Skype Яан Таллінн та багато інших.

Підписанти вважають, що продукти зі ШІ "можуть становити серйозну загрозу суспільству та людству". Працюючи з ними слід бути дуже уважними, однак цього не відбувається.

"Системи штучного інтелекту з конкурентоспроможним інтелектом можуть становити серйозні ризики для суспільства та людства... Як зазначено в широко схвалених Принципах ІІ Asilomar, просунутий ШІ може стати глибокою зміною в історії життя на Землі, і його слід планувати й керувати ним з відповідною ретельністю та ресурсами. На жаль, такого рівня планування та управління не існує, навіть попри те, що останніми місяцями лабораторії штучного інтелекту застрягли в неконтрольованій гонці з розробки та розгортання все більш потужних цифрових умів, які ніхто — навіть їхні творці — не може зрозуміти, прогнозувати чи надійно контролювати", – йдеться в листі.

Експерти та керівники галузі, які підписали лист, вважають, що навчання треба зупинити, доки не з'являться загальні протоколи безпеки.

На їхнє переконання, якщо творці ШІ-продуктів не зможуть влаштувати піврічну паузу самостійно, в це повинен втрутитися уряд.

При цьому дехто з тих, чиї підписи стоять під листом, заявили, що їхні імена просто використали, а насправді вони нічого не підписували.

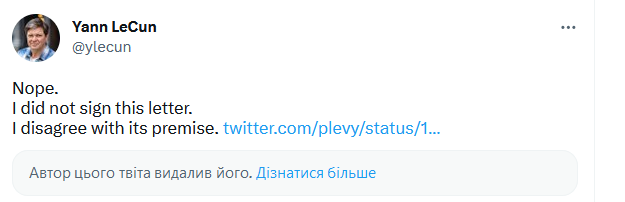

Так, професор Нью-Йоркського Університету Ян Лекан заявив у Twitter, що не підписував жодного відкритого листа проти ШІ, хоча його підпис там стоїть. Ще більше запитань викликав той факт, що згодом цей твіт видалили.

Крім цього, з листа зникли імена Білла Гейтса та Сема Альтмена, а уважні користувачі відшукали в документі кілька фейкових імен із підписами, що викликало запитання про достовірність поданих у ньому даних.

Раніше OBOZREVATEL розповідав про те, що насправді може GPT-4, і чому його можливості вражають.

Також чат-бот GPT-4 сказав, які професії ШІ може відібрати у людей

Лише перевірена інформація нас у Telegram-каналі Obozrevatel та у Viber. Не ведіться на фейки!